Para ilmuwan di Massachusetts Institute of Technology (MIT) melatih algoritma kecerdasan buatan yang dijuluki sebagi “Norman” untuk menjadi seorang psikopat hanya dengan memaparkannya pada gambar-gambar dari Reddit yang mengerikan tentang kematian dan kekerasan, menurut sebuah penelitian baru.

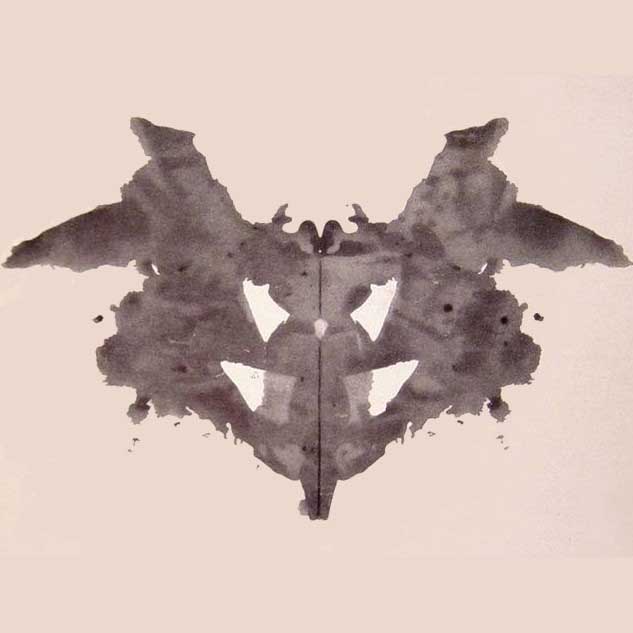

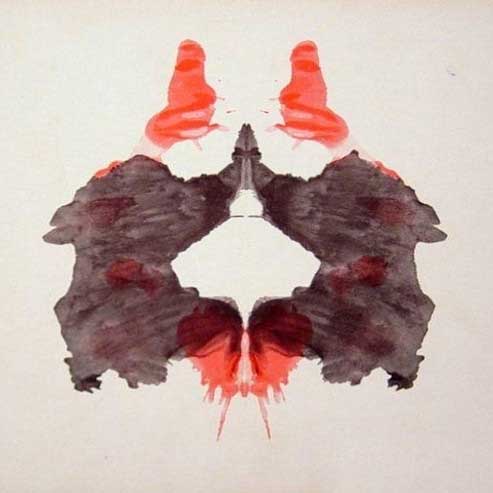

Dijuluki “Norman” berdasarkan karakter Anthony Perkins dalam film Alfred Hitchcock 1960 Psycho, kecerdasan buatan hanya diberikan berbagai jenis gambar kekerasan secara terus-menerus dari berbagai subreddit sebelum diuji dengan tes gambar abstrak dari tinta yang disebut Rorschach inkblot.

Penelitian mereka bertujuan untuk membuktikan bahwa metode input yang digunakan untuk mengajarkan suatu algoritma pembelajaran-mesin [disiplin ilmu yang mencakup perancangan dan pengembangan algoritme yang memungkinkan komputer untuk mengembangkan perilaku yang didasarkan pada data empiris] sangat mempengaruhi perilakunya di kemudian hari.

Citra yang dideteksi oleh Norman menghasilkan interpretasi menyeramkan yang selalu dikaitkan dengan kematian dan kekerasan dibandingkan dengan AI standar.

Para ilmuwan MIT yang terdiri dari Pinar Yanardag, Manuel Cebrian dan Iyad Rahwan secara khusus melatih AI untuk melakukan penggambaran citra, suatu “metode pembelajaran mendalam” untuk kecerdasan buatan untuk memilah-milah gambar dan menghasilkan deskripsi yang sesuai secara tertulis.

Para ilmuwan berpendapat bahwa ketika algoritma dituduh bias atau tidak adil, seperti kasus berita kalangan-atas di Facebook atau Foto Google , “pelakunya sering bukan algoritma itu sendiri tetapi karena bias data yang dimasukkan ke dalamnya.”

Hermann Rorschach menciptakan tes Rorschachpada tahun 1921 sebagai tes psikologi di mana persepsi subyek terhadap inkblots dicatat dan kemudian dianalisis menggunakan interpretasi psikologis untuk memeriksa karakteristik kepribadian seseorang dan fungsi emosional.

Intinya Norman selalu mengkaitkan setiap gambar inkblots Rorschach dengan kekerasan dan kematian. Untuk lebih lanjut dapat mengunjungi situsnya : norman-ai.mit.edu

Setelah terpapar gambar-gambar negatif dan pemikiran yang menyedihkan, logika empati AI benar-benar gagal dihidupkan. Skye McDonald, profesor neuropsikologi klinis di Universitas New South Wales, mengatakan robot “Pepper” Aldebaran Robotics mungkin merupakan salah satu eksperimen paling dekat dalam pengajaran empati manusia, katanya kepada The Conversation.

Para pakar robotika berharap bahwa suatu hari kecerdasan buatan akan mampu memahami emosi manusia hanya dengan melihat ekspresi wajah seseorang. Namun, McDonald berpendapat, teknologi “masih jauh dari sepenuhnya memahami kompleksitas bagaimana empati manusia beroperasi.”

Pada sebuah acara MIT di New York bulan lalu, Andrew McAfee, co-director MIT Initiative on the Digital Economy, bergabung dengan beberapa ahli Silicon Valley yang merinci kasus-kasus masa lalu di mana rasisme dan bias telah disaring ke dalam berbagai algoritma. Panel memperingatkan bahwa selain HRD mungkin dapat membuat keputusan perekrutan yang cerdas, bias terhadap minoritas dapat ditularkan dari manusia yang memprogram algoritmanya. McAfee dan ahli teknologi lainnya membahas bias algoritmik mengatakan AI dapat tetap efektif dan tidak bias “selama” data inputnya akurat.